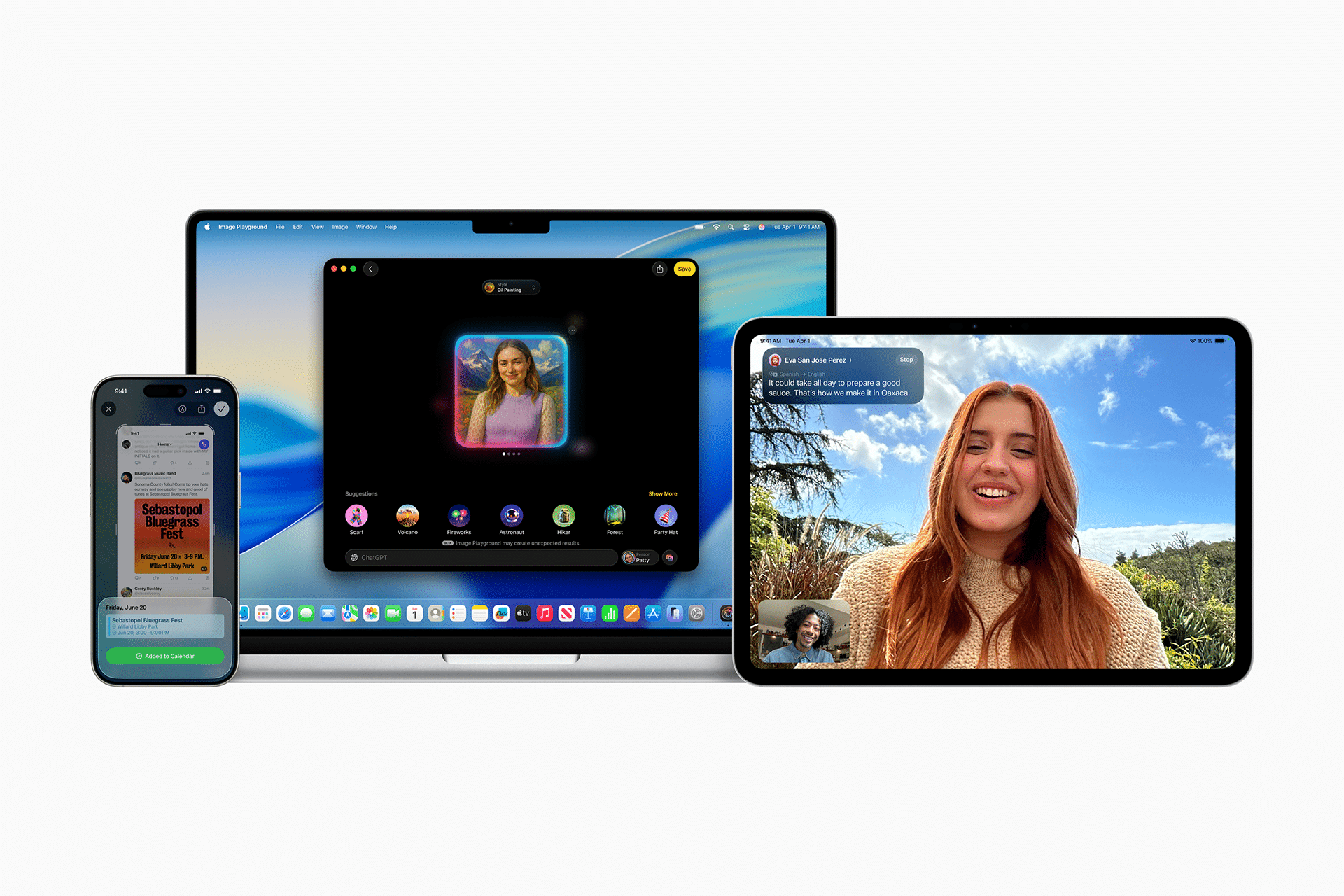

「ねえSiri、明日の会議の準備をして。」カレンダーを確認して、関連メールを探し、ブリーフィングノートまで作ってくれるSiri。SF映画の話じゃないんです。2026年3月、iOS 26.4とともに現実になります。

これは何?

2026年1月、AppleとGoogleが共同声明を発表しました。 ポイントはこれです——次世代Apple Foundation ModelsをGoogleのGemini技術の上に構築する。わかりやすく言うと、SiriのブレインがGeminiに変わるということです。

なぜこれが大きなニュースかというと。Appleはもともと「自分たちで全部作る」会社ですよね。チップも、OSも、アプリも。そのAppleがAIだけは自社開発を諦め、Googleと手を組んだんです。Bloombergの報道によると、年間約10億ドル(約1,400億円)規模の契約です。

実はAppleのAI苦戦は昨日今日の話ではありません。2024年のWWDCで「Apple Intelligence」を発表し、Siriの大幅アップグレードを約束しましたが、内部のハイブリッドアーキテクチャ(レガシーシステム+LLM)がテストケースの約1/3で失敗し、ずっと遅延していたんです。 結局、AI担当だったJohn Giannandreaが異動となり、Craig Federighi(ソフトウェア担当トップ)とMike Rockwell(Vision Proリード)がプロジェクトを引き継ぎました。

Tim Cookはこう説明しています。「コラボレーションだと思ってください。私たちは独自の取り組みも続けますが、パーソナライズされたSiriを動かしているのはGoogleとの協業です。」 重要なのは、ユーザー側からは何も変わって見えないということ。Googleのロゴは表示されません。SiriはあくまでSiriです——ただし、中身がまるごと変わるんです。

何が変わるのか?

これまでのSiriの最大の問題は何だったでしょう?「わかりました、ウェブ検索の結果です」で終わる、あの物足りない回答。Geminiベースに変わったSiriは根本から違います。キーワードを解析するのではなく、文脈を理解する統合LLMコアとして完全に作り直されました。

| 従来のSiri | GeminiベースのSiri(iOS 26.4以降) | |

|---|---|---|

| 理解力 | キーワードマッチング、単純な命令解析 | 文脈・ニュアンスの理解、代名詞の追跡 |

| タスク | 単一アプリ、単一動作 | マルチステップ、クロスアプリ自動化 |

| 個人コンテキスト | ほぼなし | メール・メッセージ・写真・カレンダーを参照 |

| 画面認識 | 不可 | 現在の画面内容を認識+アクション |

| 応答速度 | 1〜3秒 | 0.5秒以内 |

| プライバシー | オンデバイス+クラウド | オンデバイス+Private Cloud Compute を維持 |

Craig Federighiはこう語っています。「今回のパートナーシップのおかげで、当初発表したよりもはるかに大きなアップグレードを提供できる立場になりました。」

具体的に何ができるようになるかというと:

- 「エリックがアイススケートの話をしていたメール、探して」——キーワードなしで文脈だけからメールを見つけます。

- 「このアドレスをエリックの連絡先に追加して」——テキストメッセージの画面を見てアドレスを認識し、連絡先アプリに保存します。

- 「この写真を補正してメモアプリに入れて」——写真を編集後、別のアプリに移動して作業を完了します。

- 「私のパスポート番号って何番?」——写真に保存されたパスポート画像から番号を読み取ります。

まだ本格的なチャットボットではありません

iOS 26.4のSiriには、長期記憶や長い会話機能は含まれていません。本格的なチャットボットレベルの会話は、iOS 27(2026年9月)で提供される予定です。 また、一部の高度な機能は内部テストで品質の問題が見つかり、iOS 26.5(5月)に延期される可能性があるという報道もあります。

なぜよりによってGoogleなのか?

Appleが検討した候補はほかにもありました。OpenAIとはすでにChatGPT連携を行っており、Anthropic(Claude)も候補に挙がっていました。それでも最終的にGoogleを選んだのには理由があります:

- 技術力:Gemini 3がGPT-4.5と同等またはそれ以上のベンチマーク結果

- インフラ:数十年にわたる検索・YouTubeのインフラ、独自AIチップ(TPU)、数十億件のクエリ処理実績

- プライバシー:AppleのPrivate Cloud Computeで動作可能なアーキテクチャ

- 既存の関係:Safariのデフォルト検索エンジン契約で、すでに年間数十億ドルを取引している間柄

- コスト競争力:OpenAIと比べてより効率的なコスト構造

このディールの影響で、OpenAIのChatGPTモバイルシェアは69.1%から45.3%に低下し、Geminiは14.7%から25.1%に急伸しました。 Fortuneはこのディールを「GoogleがAI競争で主導権を握ったシグナル」と分析しています。

始め方のポイント

- 自分のiPhoneの対応確認

iPhone 15 Pro以上が必要です。 旧モデルでは一部の機能のみ対応する可能性があります。 - iOS 26.4へのアップデート

2026年3月リリース予定です。 設定→一般→ソフトウェアアップデートからすぐに受け取れます。 - Apple Intelligenceを有効化

設定→Apple Intelligence & Siriで機能をオンにしてください。言語設定が英語(米国)になっている場合、初期段階ではすべての機能が動作します。 - シンプルなマルチステップ命令をテスト

「明日の会議スケジュールを確認して、関連メールを探して」のような2段階以上のリクエストをしてみてください。従来のSiriとの違いをすぐに実感できます。 - クロスアプリ自動化を活用

「この写真を補正してメモアプリに入れて」のようなアプリをまたぐ命令を試してみてください。Siriがアプリをまたいで作業を処理します。

開発者はApp Intentsへの対応を

サードパーティアプリもSiriのクロスアプリ自動化に参加できます。AppleのApp Intentsフレームワークを通じてアプリのアクションをSiriに公開すると、ユーザーが音声であなたのアプリの機能を呼び出せるようになります。