LLM 파인튜닝이라고 하면 떠오르는 이미지가 있죠. 터미널에서 CUDA 환경 세팅하고, 데이터셋 포맷 맞추느라 삽질하고, 결국 GPU 메모리 부족으로 OOM 에러. 이 과정을 처음부터 끝까지 웹 브라우저에서, 코드 없이 할 수 있다면요?

이게 뭔데?

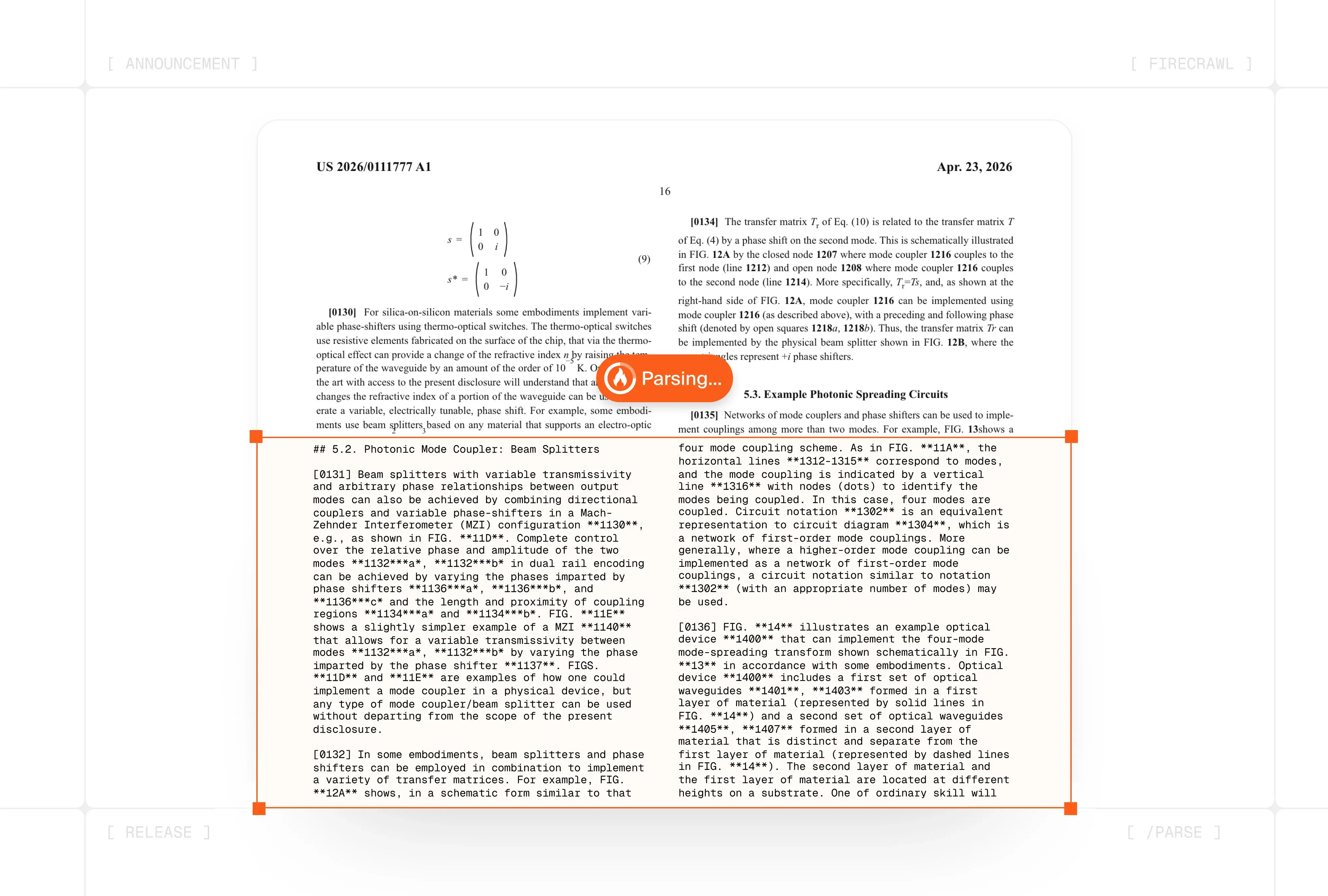

Unsloth Studio는 2026년 3월 17일에 공개된 오픈소스 노코드 웹 UI예요. LLM을 훈련하고, 실행하고, 내보내는 전 과정을 하나의 로컬 인터페이스에서 처리해요. Unsloth라는 이름, 혹시 들어보셨나요? GitHub 스타 53,900개를 넘긴 오픈소스 파인튜닝 라이브러리인데, 이번에 거기에 웹 UI를 얹은 거예요.

핵심은 간단해요. 코드를 몰라도 파인튜닝을 할 수 있게 만든 것. 데이터 준비부터 훈련, 실시간 모니터링, 모델 비교, 내보내기까지 — 전부 브라우저에서요. 그것도 100% 로컬에서 돌아가니까, 데이터가 외부로 나갈 걱정도 없어요.

지원 모델이 500개가 넘어요. Qwen 3.5, DeepSeek-R1, Llama 4, NVIDIA Nemotron 3 같은 최신 모델은 물론이고, 텍스트뿐 아니라 비전, TTS, 오디오, 임베딩 모델까지 커버해요.

뭐가 달라지는 건데?

지금까지 LLM 파인튜닝의 선택지는 크게 세 가지였어요. 코드로 직접 하거나, 클라우드 플랫폼에 돈을 내거나, 포기하거나. Unsloth Studio는 네 번째 길을 열었어요.

| 수동 파인튜닝 (코드) | 클라우드 플랫폼 | Unsloth Studio | |

|---|---|---|---|

| 코딩 필요 | Python, CUDA 필수 | 최소한 (API 수준) | 불필요 (노코드) |

| 비용 | GPU 하드웨어만 | 시간당 과금 ($2~10/hr) | 완전 무료 |

| 데이터 프라이버시 | 로컬 보관 | 외부 서버 전송 | 100% 로컬 |

| 훈련 속도 | 표준 (1x) | 표준 (1x) | 2~5배 빠름 |

| VRAM 사용 | 표준 | 서버에서 처리 | 70% 절약 |

| 데이터셋 준비 | 수동 코딩 | 일부 자동화 | PDF 업로드만으로 자동 생성 |

| 내보내기 | 수동 변환 | 플랫폼 종속 | GGUF, Ollama, vLLM 원클릭 |

비밀은 Unsloth가 직접 손으로 작성한 Triton 커널에 있어요. PyTorch의 범용 CUDA 커널 대신, LLM 아키텍처에 최적화된 역전파 연산을 Triton으로 새로 구현한 거예요. 덕분에 정확도 손실 없이 2배 빠른 속도와 70% 메모리 절약을 동시에 달성했어요.

실제 숫자로 보면 이런 느낌이에요. RTX 4090 한 장이면 8B 파라미터 모델을 파인튜닝할 수 있어요. 원래라면 멀티 GPU 클러스터가 필요했을 작업이에요. MoE(Mixture-of-Experts) 아키텍처에서는 최대 12배까지 빨라지기도 하고요.

"Unsloth는 거의 모든 Fortune 500 기업이 사용하고 있으며, 독립 LLM 배포 플랫폼 중 4위 규모입니다."

— Daniel Han, Unsloth 설립자, Hacker News 댓글

핵심 기능: 이게 되네?

Data Recipes — PDF 올리면 데이터셋이 나온다

파인튜닝의 가장 큰 삽질 포인트가 데이터셋 준비잖아요. Unsloth Studio의 Data Recipes는 비주얼 노드 기반 워크플로우로 이걸 해결해요. PDF, CSV, DOCX, JSON 파일을 업로드하면, NVIDIA의 DataDesigner 기술을 활용해 자동으로 학습용 데이터셋으로 변환해줘요. ChatML이든 Alpaca든 포맷도 알아서 맞춰요.

GRPO — 추론 능력 강화 학습

일반적인 SFT(지도 학습 파인튜닝)만 되는 게 아니에요. DeepSeek-R1의 추론 능력을 만든 핵심 기법인 GRPO(Group Relative Policy Optimization)가 내장되어 있어요. 기존 PPO는 별도의 Critic 모델이 필요해서 VRAM을 두 배로 잡아먹었는데, GRPO는 그룹 단위로 보상을 계산하니까 소비자용 GPU에서도 가능해요.

Model Arena — 훈련 전후 비교

베이스 모델과 파인튜닝된 모델을 나란히 놓고 대화시켜볼 수 있어요. 훈련 효과를 직관적으로 확인할 수 있는 기능이에요.

원클릭 내보내기

훈련이 끝나면 GGUF(llama.cpp, Ollama, LM Studio용), safetensors(HuggingFace, vLLM용) 등으로 바로 내보낼 수 있어요. LoRA 어댑터 병합부터 포맷 변환까지 자동 처리돼요.

핵심만 정리: 시작하는 법

- 원라인 설치

Mac/Linux/WSL에서 터미널에 한 줄만 입력하면 돼요.curl -fsSL https://raw.githubusercontent.com/unslothai/unsloth/main/install.sh | sh

Windows는 PowerShell에서:irm https://raw.githubusercontent.com/unslothai/unsloth/main/install.ps1 | iex

Docker도 지원해요. 첫 설치 시 llama.cpp 컴파일 때문에 5~10분 걸려요. - Studio 실행

source unsloth_studio/bin/activate후unsloth studio -H 0.0.0.0 -p 8888을 실행하면 브라우저에서 Studio가 열려요. GPU 없는 Mac에서도 GGUF 추론과 Data Recipes는 사용할 수 있어요. - 모델 선택

Hugging Face에서 모델을 검색하거나, 이미 다운받은 GGUF/safetensors 파일을 로드해요. LM Studio에서 받아둔 모델도 자동 감지돼요. - 데이터 준비 (Data Recipes)

학습시키고 싶은 문서(PDF, CSV 등)를 업로드하면 노드 기반 에디터에서 데이터셋으로 변환돼요. 합성 데이터 생성도 가능해요. 데이터 없이 바로 훈련할 수도 있어요. - 훈련 시작

추천 프리셋으로 바로 시작하거나, YAML 설정을 불러와서 세밀하게 조정할 수 있어요. 훈련 중 loss 곡선, GPU 사용률을 실시간으로 보면서 — 심지어 폰에서도 확인 가능해요. - 내보내기 & 배포

훈련이 끝나면 GGUF, safetensors 등 원하는 포맷으로 내보내요. Ollama에 바로 올리거나, vLLM 서버에 배포하거나, HuggingFace Hub에 푸시하면 끝이에요.

GPU가 없다면?

Google Colab의 무료 T4 GPU에서도 Unsloth Studio를 실행할 수 있어요. 22B 파라미터 모델까지 훈련 가능해요. 다만 llama.cpp 컴파일에 30분 이상 걸리니까, 더 큰 GPU를 선택하면 좋아요.

어디에 쓸 수 있을까?

파인튜닝은 범용 AI를 '내 업무 전문가'로 바꾸는 작업이에요. Unsloth Studio가 특히 빛나는 시나리오들이에요:

- 사내 지식 챗봇 — 회사 문서(PDF, 매뉴얼)를 Data Recipes로 데이터셋화해서, 사내 용어와 프로세스를 이해하는 챗봇을 만들 수 있어요. 데이터가 외부로 나가지 않으니까 보안 걱정도 없고요.

- 도메인 특화 코딩 어시스턴트 — 우리 팀의 코드 스타일, 사용하는 프레임워크, 내부 API 문서를 학습시켜서 팀 전용 Copilot을 만들 수 있어요.

- 다국어 전문 번역 — 특정 분야(법률, 의료, 게임)의 전문 용어 번역 품질을 대폭 올릴 수 있어요.

- 추론 능력 강화 — GRPO로 수학, 논리, 코딩 문제 해결 능력을 강화한 '미니 DeepSeek-R1'을 만들 수 있어요.

경쟁 도구 비교

| Unsloth Studio | LLaMA-Factory | HF AutoTrain | Together AI | |

|---|---|---|---|---|

| 타입 | 로컬 웹 UI (오픈소스) | 로컬 웹 UI (오픈소스) | 클라우드 SaaS | 클라우드 API |

| GitHub 스타 | 53.9K | 68.4K | - | - |

| 훈련 속도 | 2~5x 빠름 | 표준 | 표준 | 표준 |

| VRAM 절약 | 최대 70% | 표준 | 서버 처리 | 서버 처리 |

| 데이터셋 생성 | Data Recipes (비주얼) | 수동 | 일부 자동 | 수동 |

| GRPO 지원 | 내장 | 지원 | 미지원 | 미지원 |

| 비용 | 무료 | 무료 | 유료 | 유료 |

| 프라이버시 | 100% 로컬 | 100% 로컬 | 클라우드 | 클라우드 |

| 약점 | Mac 훈련 미지원 (곧 지원) | 디버깅 어려움, 문서 부족 | 커스터마이징 제한 | 지속 비용, 벤더 종속 |

LLaMA-Factory가 모델 호환성에서는 앞서지만, 속도와 메모리 효율에서 Unsloth Studio가 압도적이에요. 특히 소비자용 GPU로 작업하는 개인 개발자나 소규모 팀에게는 사실상 유일한 선택지에 가까워요.

주의할 점

현재 베타 버전이에요. 훈련은 NVIDIA GPU만 지원하고, Mac에서는 추론과 Data Recipes만 가능해요 (MLX 훈련은 곧 지원 예정). AMD·Intel GPU 지원도 로드맵에 있어요. 또한 Studio UI는 AGPL-3.0 라이선스라서, 내부 SaaS로 변형해서 서비스하려면 소스코드 공개 의무가 있어요.