Claude Codeに「認証システムを作って」と言うとサクッとコードが出てきます。でもそのコードをどうやってレビューしますか?ターミナルをスクロールして目で流して、「3番目の関数でbcryptじゃなくてargon2idを使って」とタイピングしていませんか?

PydanticチームのLaura Summersはこれを「監督疲労(supervision fatigue)」と呼びました。AIが作る大量の「ほぼ正しい」コードを人間が一つひとつ検証する新しい種類の疲労感です。Martin Fowlerチームはこの問題に「human on the loop」というフレームを提案しました。コードを一行ずつ検査するのではなく、エージェントがうまく機能するシステム(harness)を設計することが開発者の新しい役割だということです。

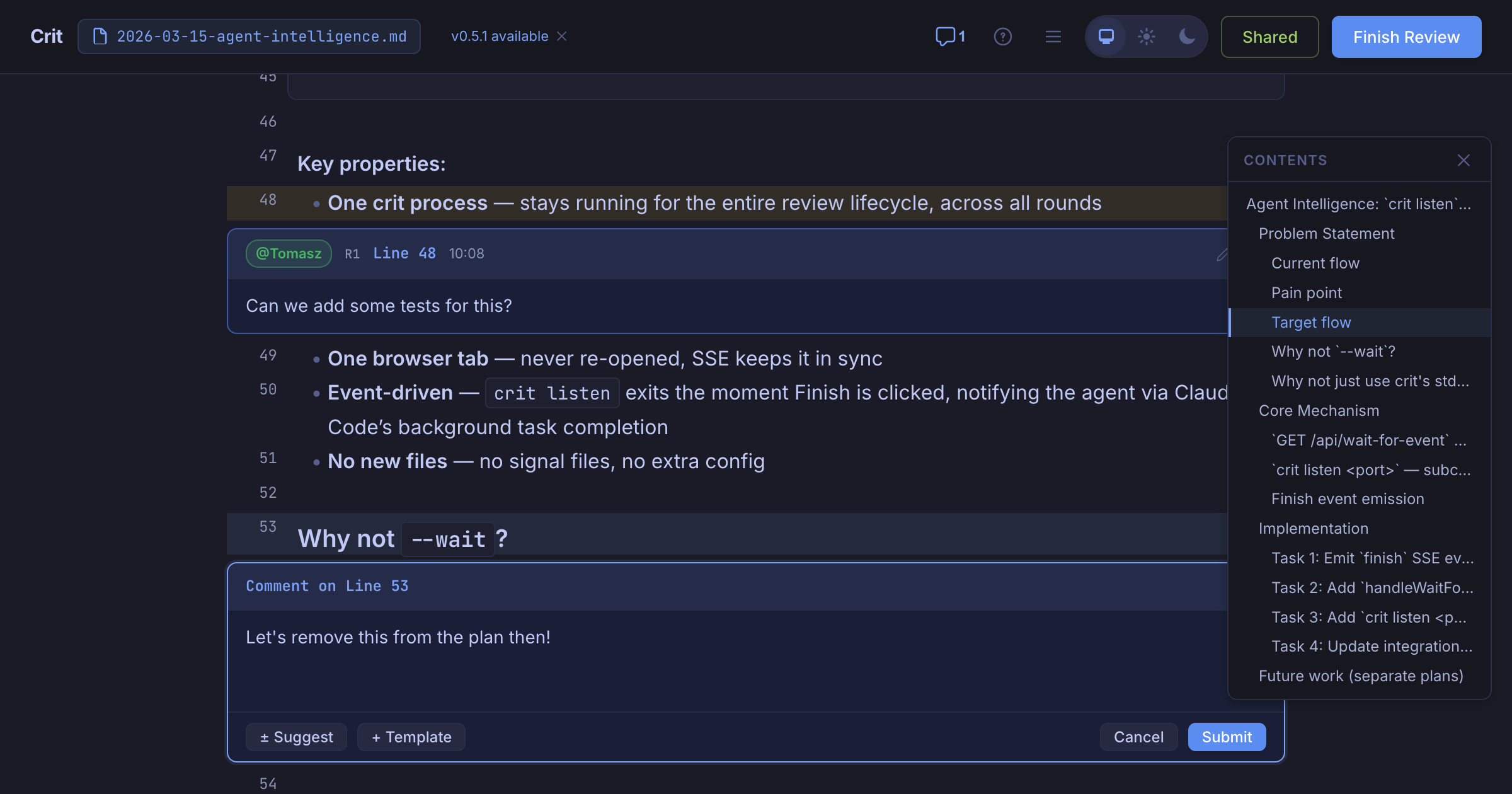

Critはこの問題を正面から解決するCLIツールです。AIエージェントが作ったプランでも、コードの変更でも、GitHub PRのようにブラウザでインラインコメントを残して、エージェントにフィードバックを自動で渡せます。

これは何?

CritはポーランドのエンジニアTomasz Tomczykが作ったオープンソースCLIツールです。Claude CodeとCursorを使いながら「もっともらしいけど間違っているコード(plausible-but-wrong)」が出たとき、PRを作らずとも構造的にフィードバックする方法がなくて自分で作ったと言います。

ポイントはレビューループ(review loop)です。コメントを残してFinish Reviewを押すと、エージェントが自動でフィードバックを受け取ってコードを修正し、Critが変更されたdiffを再び表示します。前のラウンドのコメントもそのまま残っているので、漏れがないか確認できます。Claude Code、Cursor、GitHub Copilot、Aider、Cline、Windsurfなどファイルを読めるすべてのエージェントと互換性があります。

何が変わるの?

AIコードレビューツールはすでに多くあります。CodeRabbit、Qodo、GitHub Copilot PRレビューなど。でもこれらはAIがAIをレビューするツールです。Critは方向が逆。人間がAIをレビューするツールです。

| アプローチ | 方向 | 特徴 |

|---|---|---|

| GitHub PRレビュー | 人間 → 人間 | よく機能するが、AIエージェントの作業中にPRを作るには重い |

| CodeRabbit、Qodoなど | AI → AI(人間監督) | PRが上がった後に自動レビュー。エージェント作業中の介入不可 |

| Crit | 人間 → AI | エージェントがコードを書く最中にインラインフィードバック。ローカル実行、インストールのゼロ依存性 |

Addy Osmani(Google Chromeチーム)は2026年のコーディングワークフロー記事で「AIが作ったコードはジュニアエンジニアが書いたものとして扱え」と言いました。読んで、実行して、テストしろと。問題はその「読む」過程が構造化されていないことで、Critがまさにその空白を埋めます。

PitchのEngineering Manager Ullrich Schäferは「毎日Critでエージェントフィードバックループをタイトにしている。プランの特定セクションまでレビューできてAIコーディングが速くかつコントロール可能になった」と言い、シニアエンジニアのVincentは「プランへのPRレビューのようだ。長いプランで3番目のポイントはこう修正して7番目は削除してほしいと言っていたことを、コメント一つで解決できる」と評価しました。

始め方のポイント

今すぐ使えます。シングルバイナリなので依存性がありません。

- インストール(10秒)

Homebrew: brew install tomasz-tomczyk/tap/crit

Go: go install github.com/tomasz-tomczyk/crit@latest

またはGitHub Releasesからバイナリを直接ダウンロード - プランレビューを開始する

crit plan.mdまたはcrit(変更を自動検出)を実行するとブラウザが開きます。行番号をクリックまたはドラッグしてインラインコメントを残しましょう。Vimキーバインドも対応していてj/kで移動、cでコメント、Shift+Fでレビュー完了。 - エージェントを連携する

Claude Code、Cursor、OpenCode、GitHub Copilotは/critスラッシュコマンドに対応しています。実行するとCritが起動し、レビューを終えるとエージェントが自動でフィードバックを受け取り修正します。他のエージェントもファイルを読めれば全て互換性があります。 - コード変更をレビューする(git diff)

プランだけでなく実際のコード変更もレビューできます。critだけ実行するとgitの変更を検知してsplit/unified diffビューで表示します。ラウンド別のdiff比較も可能で「前のフィードバックが反映されたか?」の確認が簡単です。

基本はローカルのみで動作しますが、Share Review機能で公開リンクを作ることもできます。チームメンバーに「このプランどう思う?」と送るのに便利です。コメントは作成者ごとに色が分かれていて、いつでもUnpublish可能。完全なセルフホスティングが必要ならDocker ComposeでCrit-webを立ち上げることもできます。

もっと深く掘り下げたいなら

Qodoの2026年コードレビュー分析によれば、AIコーディングエージェントが開発者の生産性を25〜35%高めたが、レビュアーが検証できる量は変わっていません。PRが大きくなり、アーキテクチャのドリフトが増え、シニアエンジニアはシステム設計の代わりに検証作業に埋もれています。

Berkeley Haasの研究が明らかにしたように、AIは仕事を減らすのではなく強度を上げます。PydanticのDouweは毎朝AIが作った30件のPRをレビューしながら「それ自体をAIに任せたら、ここで何をしているのか?」と自問したと言います。Critのようなツールが注目される理由は、この監督疲労を構造化するからです。