Claude Code한테 "인증 시스템 만들어줘" 하면 뚝딱 코드가 나옵니다. 그런데 그 코드를 어떻게 검토하세요? 터미널 스크롤 올려서 눈으로 훑고, "3번째 함수에서 bcrypt 말고 argon2id 써" 하고 타이핑하고 있진 않으신가요?

Pydantic 팀의 Laura Summers는 이걸 "감독 피로(supervision fatigue)"라고 불렀습니다. AI가 만든 대량의 "거의 맞는" 코드를 사람이 일일이 검증하는 새로운 종류의 피로감이요. Martin Fowler 팀은 이 문제에 "human on the loop"이라는 프레임을 제안했고요. 코드를 한 줄씩 검사하는 게 아니라, 에이전트가 잘 작동하는 시스템(harness)을 설계하는 것이 개발자의 새 역할이라는 겁니다.

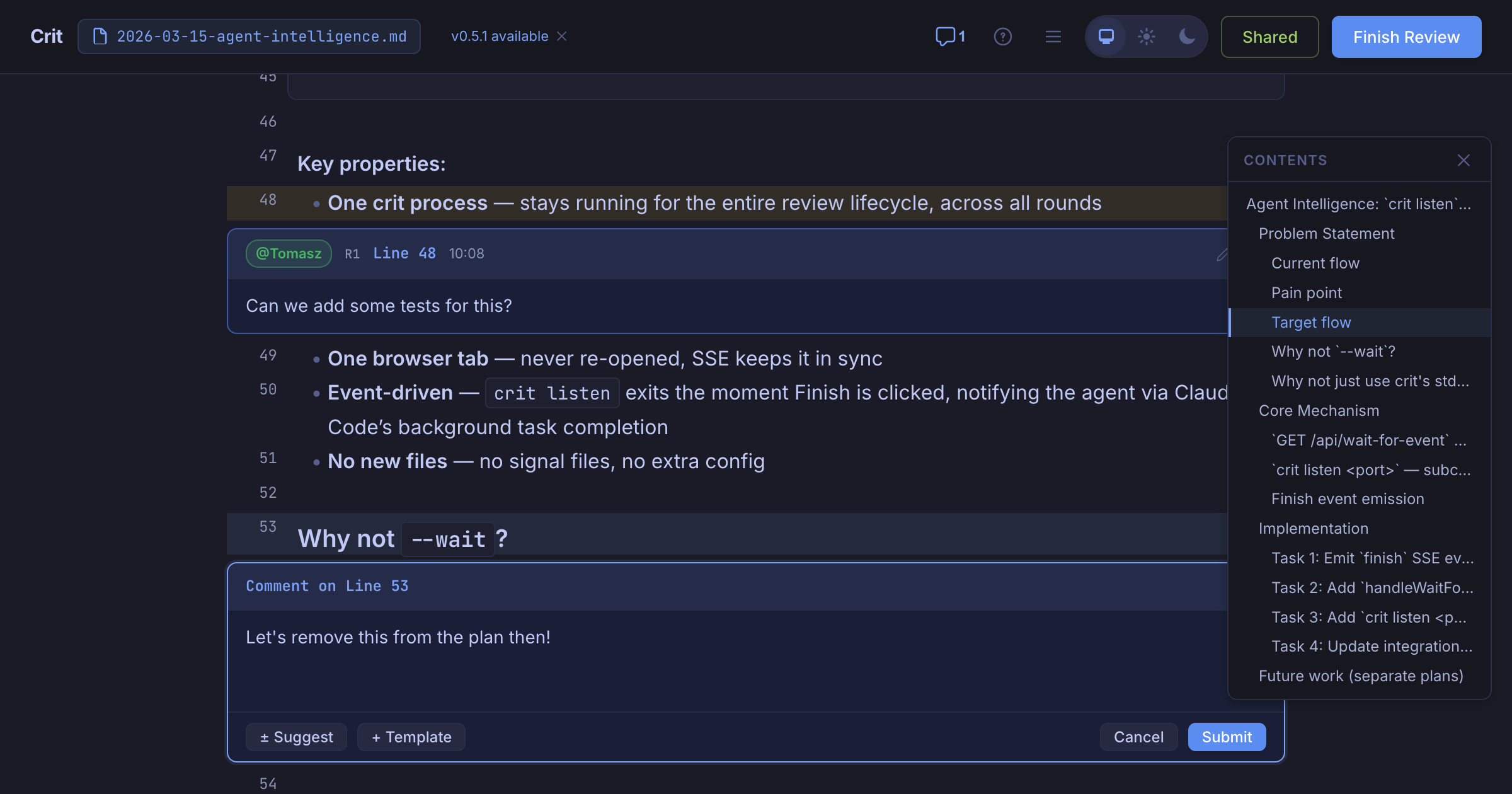

Crit은 바로 이 문제를 정면으로 해결하는 CLI 도구입니다. AI 에이전트가 만든 플랜이든, 코드 변경이든, GitHub PR처럼 브라우저에서 인라인 코멘트를 남기고 에이전트한테 피드백을 자동으로 넘길 수 있어요.

이게 뭔데?

Crit은 폴란드 개발자 Tomasz Tomczyk이 만든 오픈소스 CLI 도구입니다. Claude Code와 Cursor를 쓰면서 "그럴듯하지만 틀린 코드(plausible-but-wrong)"가 나왔을 때, PR을 만들지 않고도 구조적으로 피드백할 방법이 없어서 직접 만들었다고 해요.

핵심은 리뷰 루프(review loop)입니다. 코멘트를 남기고 Finish Review를 누르면, 에이전트가 자동으로 피드백을 가져가서 코드를 수정하고, Crit이 변경된 diff를 다시 보여줍니다. 이전 라운드의 코멘트도 그대로 남아있어서 빠진 게 없는지 확인할 수 있고요. Claude Code, Cursor, GitHub Copilot, Aider, Cline, Windsurf 등 파일을 읽을 수 있는 모든 에이전트와 호환됩니다.

뭐가 달라지는 건데?

AI 코드 리뷰 도구는 이미 많습니다. CodeRabbit, Qodo, GitHub Copilot PR 리뷰 등. 그런데 이것들은 AI가 AI를 리뷰하는 도구예요. Crit은 방향이 반대입니다. 사람이 AI를 리뷰하는 도구죠.

| 접근법 | 방향 | 특징 |

|---|---|---|

| GitHub PR 리뷰 | 사람 → 사람 | 잘 작동하지만, AI 에이전트 작업 중간에 PR을 올리긴 무겁다 |

| CodeRabbit, Qodo 등 | AI → AI (사람 감독) | PR이 올라온 뒤 자동 리뷰. 에이전트 작업 중간 개입 불가 |

| Crit | 사람 → AI | 에이전트가 코드를 짜는 중간에 인라인 피드백. 로컬 실행, 설치 제로 의존성 |

Addy Osmani(Google Chrome 팀)는 2026년 코딩 워크플로우 글에서 "AI가 만든 코드는 주니어 개발자가 짠 것처럼 취급하라"고 했습니다. 읽어보고, 실행하고, 테스트하라고요. 문제는 그 "읽어보는" 과정이 구조화되어 있지 않다는 건데, Crit이 바로 그 빈 자리를 채웁니다.

Pitch의 Engineering Manager Ullrich Schäfer는 "매일 Crit으로 에이전트 피드백 루프를 타이트하게 만든다. 플랜의 특정 섹션까지 리뷰할 수 있어서 AI 코딩이 빠르면서도 통제 가능해졌다"고 했고, Vincent(시니어 엔지니어)는 "플랜에 대한 PR 리뷰 같다. 긴 플랜에서 3번 포인트는 이렇게 고치고 7번은 빼달라고 하던 걸, 코멘트 하나로 해결한다"고 평가했습니다.

Martin Fowler 팀이 정리한 "human on the loop" 프레임으로 보면, Crit은 정확히 하네스 엔지니어링(harness engineering)의 실천 도구입니다. 에이전트가 만든 결과물을 직접 고치는 "in the loop"도 아니고, 그냥 맡기는 "outside the loop"도 아닌, 에이전트가 더 잘 작동하도록 시스템을 조율하는 "on the loop". Crit의 리뷰 루프가 바로 이 패턴의 구체적 구현이에요.

핵심만 정리: 시작하는 법

지금 바로 써볼 수 있습니다. 싱글 바이너리라 의존성이 없어요.

- 설치 (10초)

Homebrew:brew install tomasz-tomczyk/tap/crit

Go:go install github.com/tomasz-tomczyk/crit@latest

Nix:nix profile install github:tomasz-tomczyk/crit

또는 GitHub Releases에서 바이너리를 직접 다운로드 - 플랜 리뷰 시작

crit plan.md또는crit(변경사항 자동 감지)를 실행하면 브라우저가 열립니다. 줄 번호를 클릭하거나 드래그해서 인라인 코멘트를 남기세요. Vim 키바인딩도 지원해서 j/k로 이동, c로 코멘트, Shift+F로 리뷰 완료 - 에이전트 연동

Claude Code, Cursor, OpenCode, GitHub Copilot은/crit슬래시 커맨드를 지원합니다. 실행하면 Crit이 뜨고, 리뷰를 끝내면 에이전트가 자동으로 피드백을 받아 수정합니다. 다른 에이전트도 파일을 읽을 수 있으면 모두 호환돼요. - 코드 변경 리뷰 (git diff)

플랜뿐 아니라 실제 코드 변경도 리뷰할 수 있습니다.crit만 실행하면 git 변경사항을 감지해서 split/unified diff 뷰로 보여줍니다. 라운드별 diff 비교도 가능해서 "지난 피드백이 반영됐나?" 확인이 쉬워요.

기본은 로컬에서만 작동하지만, Share Review 기능으로 공개 링크를 만들 수도 있습니다. 팀원에게 "이 플랜 어떻게 생각해?" 하고 보내기 좋아요. 코멘트는 작성자별로 색상 구분되고, 언제든 Unpublish 가능. 완전한 자체 호스팅이 필요하면 Docker Compose로 crit-web을 띄울 수도 있어요.

AI 코딩의 품질 관리가 왜 이렇게 어려운가

Qodo의 2026년 코드 리뷰 분석에 따르면, AI 코딩 에이전트가 개발자 생산성을 25~35% 높였지만, 리뷰어가 검증할 수 있는 양은 그대로입니다. PR이 더 커지고, 아키텍처 드리프트가 심해지고, 시니어 엔지니어는 시스템 설계 대신 검증 작업에 묻혀요.

Berkeley Haas 연구가 밝힌 것처럼, AI는 일을 줄이는 게 아니라 강도를 높입니다. Pydantic의 Douwe는 매일 아침 AI가 만든 30개의 PR을 리뷰하며 "그 자체를 AI에게 맡기면, 내가 여기서 뭘 하고 있는 건가?"라고 자문했다고 해요. Crit 같은 도구가 주목받는 이유는 이 감독 피로를 구조화하기 때문입니다. 눈으로 훑는 게 아니라, PR처럼 체계적으로 리뷰하고 피드백하는 루프를 만드는 거죠.

Addy Osmani의 워크플로우를 보면, 스펙 작성 → 작은 단위로 분할 → 에이전트 실행 → 테스트 → 리뷰의 사이클이 핵심입니다. 여기서 "리뷰" 단계가 가장 병목인데, Crit은 정확히 그 단계를 브라우저 기반 UI로 효율화합니다. 터미널에서 줄 번호를 인용하며 피드백하던 시대와는 차원이 다른 경험이에요.