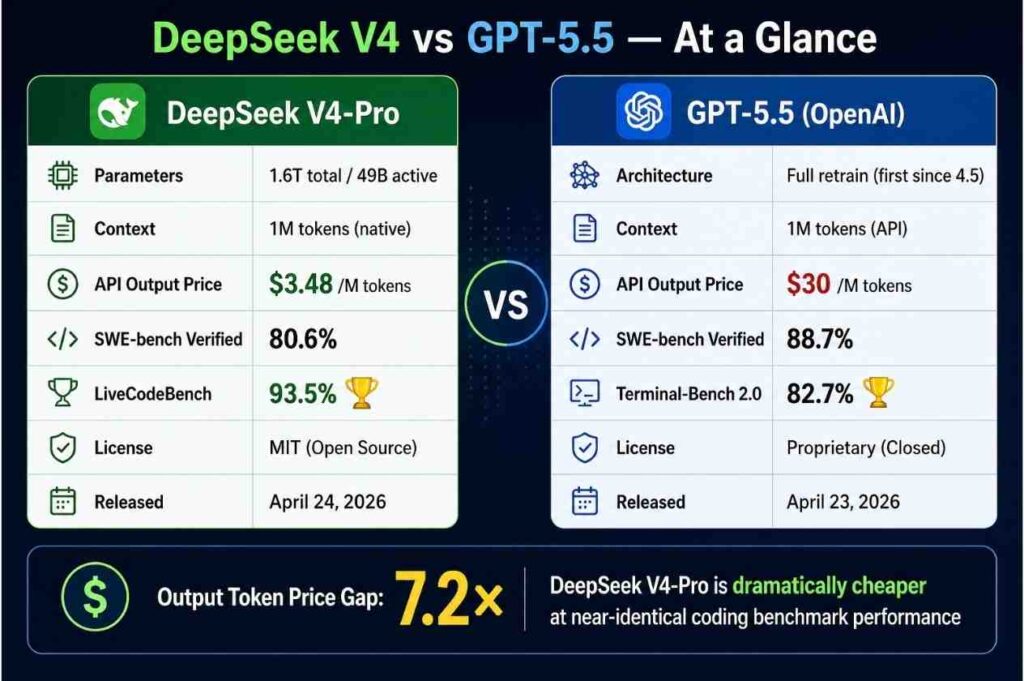

한 줄 요약DeepSeek V4-Pro가 출력 1M 토큰을 $3.48에 풀면서, GPT-5.5($30)와 9배 차이가 났어요. 중간 가격대 모델은 사라지는 중이고, 빌더는 "프론티어 + 저가 오픈모델"로 라우팅을 짜야 살아남아요.

2026년 4월, DeepSeek가 V4를 공개했어요. 1.6조 파라미터에 49B만 활성화되는 MoE 구조, MIT 라이선스, 그리고 출력 1M 토큰 $3.48이라는 가격표. 같은 주에 OpenAI는 GPT-5.5를 발표했고, 출력은 $30이에요.

표면적으로는 "또 가격 내렸네" 같은 뉴스예요. 그런데 The New Stack의 Janakiram MSV가 짚은 진짜 변화는 따로 있어요. 중간 가격대 모델이 통째로 빠져나가고 있다는 거예요.

이게 뭔데?

예전엔 LLM 시장이 입문 → 미들 → 프론티어 3단 구조였어요. 가격도 성능도 계단처럼 올라갔죠. 그런데 2026년 봄, 이 계단의 가운데 칸이 무너졌어요.

위쪽엔 GPT-5.5, Opus 4.7 같은 프론티어 모델이 있어요. 한 번에 복잡한 추론을 끝내고, 에이전트 워크플로우를 깔끔하게 돌려요. 가격은 비싸요. 1M 출력 토큰이 $25~$30예요.

아래쪽엔 DeepSeek V4-Flash, V4-Pro 같은 저가 오픈모델이 있어요. V4-Flash는 출력 $0.28, V4-Pro는 $3.48이에요. V4-Pro는 BrowseComp에서 83.4%로 Opus 4.7(79.3%)을 이겼어요. 즉 "싸지만 못 쓸 정도는 아니다"가 아니라, 일부 벤치는 프론티어를 넘어요.

그럼 가운데는요? GPT-5.4($2.50/$15), Sonnet 4($3/$15) 같은 미들 티어요. 가격은 V4-Pro의 4~5배인데 일반 워크로드 성능 차이는 미미해요. 사용자 입장에서 "굳이 미들을 쓸 이유"가 빠르게 사라지고 있어요.

뭐가 달라지는 건데?

Janakiram MSV가 이걸 "AI 미들 클래스의 소멸"이라고 부른 이유가 있어요. 미들 모델 의존도가 높은 빌더는 가격으로도, 성능으로도 갈 데가 없어요. 위는 비싸서 못 따라가고, 아래는 마진이 안 나와서 아예 다른 게임이에요.

이게 단순한 가격 변동이 아니라 구조 재편인 이유는 세 가지예요.

| 항목 | 프론티어 (GPT-5.5) | 저가 오픈 (V4-Pro) | 사라지는 미들 (GPT-5.4) |

|---|---|---|---|

| 입력 / 출력 가격 (1M) | $5 / $30 | $1.74 / $3.48 | $2.50 / $15 |

| Terminal-Bench (코딩) | 82.7% | 67.9% (Pro-Max) | 약 60%대 |

| SWE-Bench Pro | 58.6% | 55.4% | 50% 미만 |

| BrowseComp (웹 추론) | — | 83.4% | — |

| 라이선스 | 독점 API | MIT (자체 호스팅 가능) | 독점 API |

| 존재 의미 | 최고 난이도 작업 | 90% 일상 워크로드 | 점점 모호 |

벤치 출처는 Artificial Analysis, OpenAI 공식 발표, DeepSeek API Docs예요.

GPT-5.5 vs V4-Pro

활성 49B (MoE)

Opus 4.7(79.3%) 상회

자체 호스팅 합법

1. 가격 곡선이 U자가 됐어요

예전엔 가격-성능이 직선에 가까웠어요. 두 배 비싸면 두 배 좋다는 식. 지금은 가운데가 푹 꺼진 U자 곡선이에요. 같은 $3 구간에서 V4-Pro와 Sonnet 4가 비슷한 성능을 내는데, V4-Pro는 오픈웨이트라 라우팅·자체 호스팅 자유도가 훨씬 커요.

2. 라우팅이 옵션이 아니라 의무가 됐어요

Augment Code의 2026 가이드는 명확해요. "단일 모델 베팅은 끝났다". 코딩 에이전트라도 작업 복잡도에 따라 V4-Flash → V4-Pro → GPT-5.5로 분기해야 단가 곡선이 맞아요. 라우팅 안 하면 돈을 태워요.

3. 오픈웨이트가 게임 체인저가 됐어요

V4-Pro는 MIT 라이선스로 풀려서 Together AI, Fireworks, Hyperbolic 같은 호스팅 사업자가 즉시 서빙했어요. 데이터를 중국 본토로 안 보내고 싶으면 미국·EU 사업자를 쓰면 돼요. "중국 모델이라 못 쓴다"는 핑계가 작아진 셈이에요.

핵심만 정리: 시작하는 법

4단계로 라우팅 구조를 깔 수 있어요. 첫 도입은 if문 5줄로 충분해요.

- 워크로드 분류 (1일): 지난 한 달 API 호출을 "단순 분류·요약·번역" / "코드 생성·복잡 추론" / "에이전트 멀티스텝"으로 나눠요. 비율을 보면 어디에 비싼 모델이 낭비되는지 보여요.

- 2단 분기로 시작 (반나절): 단순 작업은

V4-Flash($0.14/$0.28), 복잡 작업은GPT-5.5또는Opus 4.7로 보내요. 가운데 V4-Pro는 단순이 어려워질 때 fallback으로 둬요. - 게이트웨이 도입 (1주): 트래픽이 늘면 OpenRouter, Portkey, LiteLLM 중 하나로 옮겨요. SDK 한 줄 바꾸면 모델 가중치, 비용 한도, 자동 fallback이 다 들어와요.

- 관측·튜닝 루프: 모델별 평가 데이터셋(자기 도메인 100~300건)을 만들고 주 1회 회귀 테스트. "정확도 - 비용" 파레토 프론티어에서 모델을 빼고 더해요.