디즈니가 내용증명을 보내고, MPA가 성명을 내고, SAG-AFTRA가 규탄했어요. 출시 하루 만에 할리우드 전체를 뒤흔든 AI 영상 생성기가 나왔습니다. 이름은 Seedance 2.0. 바이트댄스가 만들었고, 무료로 쓸 수 있어요.

이게 뭔데?

Seedance 2.0은 바이트댄스의 Seed 연구팀이 2026년 2월에 공개한 AI 영상 생성 모델이에요. 텍스트, 이미지, 영상, 오디오를 넣으면 최대 15초짜리 2K 해상도 영상을 만들어줘요. 여기까지는 다른 AI 영상 생성기와 비슷하죠?

근데 Seedance 2.0은 영상과 오디오를 동시에 생성해요. 이게 핵심이에요. 기존 도구들은 무음 영상을 만들고, 별도로 오디오를 붙이고, 립싱크를 맞추는 과정이 따로 필요했어요. Seedance 2.0은 이 전체 과정을 한 번에 처리해요. 문이 닫히면 닫히는 소리가 나고, 캐릭터가 말하면 입 모양이 정확히 맞아요.

바이트댄스가 만들었다는 게 중요해요. 틱톡, 더우인, 캡컷을 운영하는 회사잖아요. 지구상에서 가장 많은 영상을 처리하는 회사가 "뭐가 좋은 영상인지"를 학습 데이터로 가지고 있는 거예요. 그래서 출시 직후 X(트위터)에서 바이럴이 터졌어요. 한 중국 사용자는 "합작 파트너가 하루 종일 못 만들던 효과를, 5분 만에 끝냈다"고 했고요.

Seedance 2.0의 핵심 기능을 정리하면 이래요:

- 멀티모달 입력 (최대 12개 파일)

이미지 9개 + 영상 3개 + 오디오 3개를 한 번에 넣을 수 있어요. "이 사람 얼굴", "이 배경", "이 카메라 무빙", "이 음악 리듬"을 파일로 지시하는 거예요. - 네이티브 오디오 생성

대화, 효과음, 배경음이 영상과 동시에 생성돼요. 8개 언어 립싱크를 지원하고, 음악의 비트에 맞춰 컷 전환도 해줘요. - 캐릭터 일관성

여러 장면을 만들어도 캐릭터의 얼굴, 옷, 체형이 바뀌지 않아요. 이전 모델에서 가장 큰 불만이었던 부분이 개선됐어요.

저작권 논란은 알고 쓰세요

Seedance 2.0으로 스파이더맨, 다스 베이더, 베이비 요다 같은 캐릭터 영상이 대량 생산되면서 디즈니가 내용증명을 보냈고, 파라마운트도 뒤따랐어요. MPA는 "저작권 침해"라고 규탄했고, SAG-AFTRA도 성명을 냈어요. 상업용으로 쓸 때는 내가 권리를 가진 소스만 레퍼런스로 사용하세요.

뭐가 달라지는 건데?

AI 영상 생성기는 이미 많아요. Sora, Veo, Kling, Runway. 근데 대부분 "무음 영상"을 만들고, 오디오는 별도로 붙여야 했어요. Seedance 2.0은 이 과정 전체를 하나로 합쳤어요.

| 기존 워크플로우 | Seedance 2.0 | |

|---|---|---|

| 오디오 | 무음 → 별도 오디오 제작 → 수동 싱크 | 영상+오디오 동시 생성 |

| 립싱크 | 별도 립싱크 도구 필요 | 8개 언어 네이티브 립싱크 |

| 해상도 | 대부분 1080p | 최대 2K (2048x1080) |

| 참조 입력 | 텍스트 + 이미지 1~2개 | 최대 12개 (이미지/영상/오디오/텍스트) |

| 캐릭터 일관성 | 장면 바뀌면 외모도 바뀜 | 다중 장면에서 일관성 유지 |

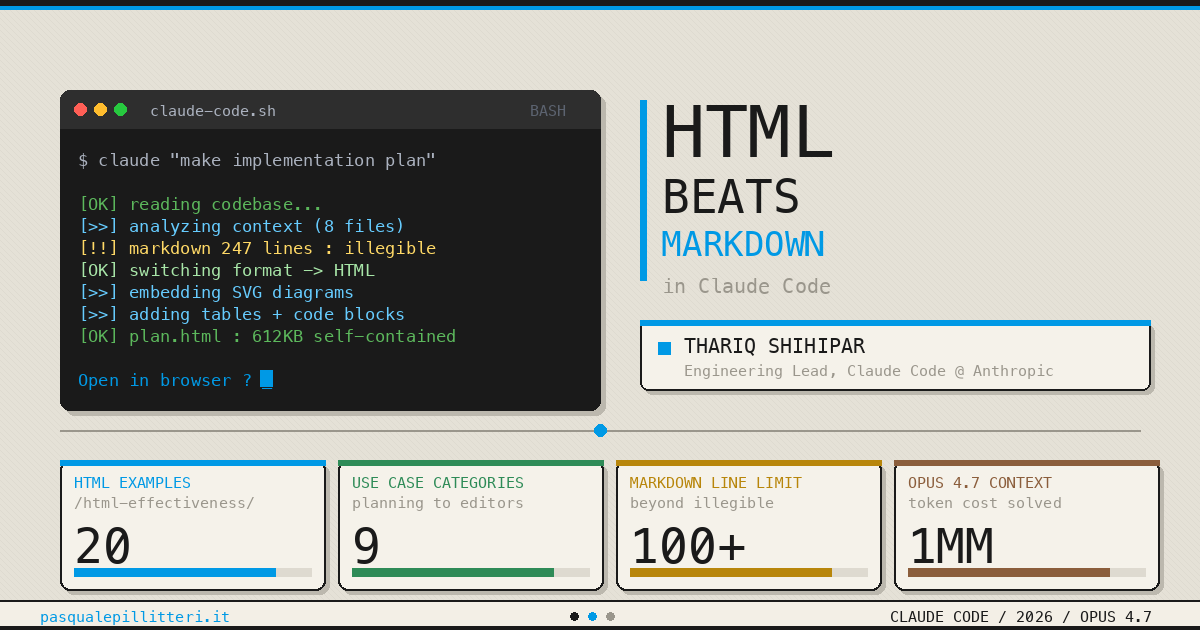

경쟁 모델들과 좀 더 구체적으로 비교하면요:

| 모델 | 네이티브 오디오 | 최대 길이 | 해상도 | 강점 |

|---|---|---|---|---|

| Seedance 2.0 | O | 15초 | 2K | 오디오 동시 생성, 12개 참조 파일 |

| Sora 2 (OpenAI) | X | 60초 | 1080p | 긴 클립, 물리 정확도 최고 |

| Kling 3.0 (콰이쇼우) | X | 10초 | 1080p | 빠른 생성, 모션 브러시 |

| Veo 3.1 (Google) | O | 8초 | 4K | 최고 해상도, Google Cloud 연동 |

Seedance 2.0의 핵심 차별점은 "오디오까지 한 번에"예요. Hacker News에서 한 사용자는 "오디오가 사후 고려사항처럼 느껴지지 않는 첫 번째 모델"이라고 평가했어요. 다만 15초 상한이라는 한계는 있어요. 긴 영상이 필요하면 Sora 2(최대 60초)가 더 나은 선택이에요.

실전 팁: 레퍼런스 역할 분배가 핵심

텍스트 프롬프트를 길게 쓰는 것보다 레퍼런스 파일에 역할을 나눠주는 게 결과가 좋아요. 예: 이미지 1장은 "인물", 이미지 2장은 "배경 무드", 영상 1개는 "카메라 무빙", 오디오 1개는 "리듬 기준".

핵심만 정리: 시작하는 법

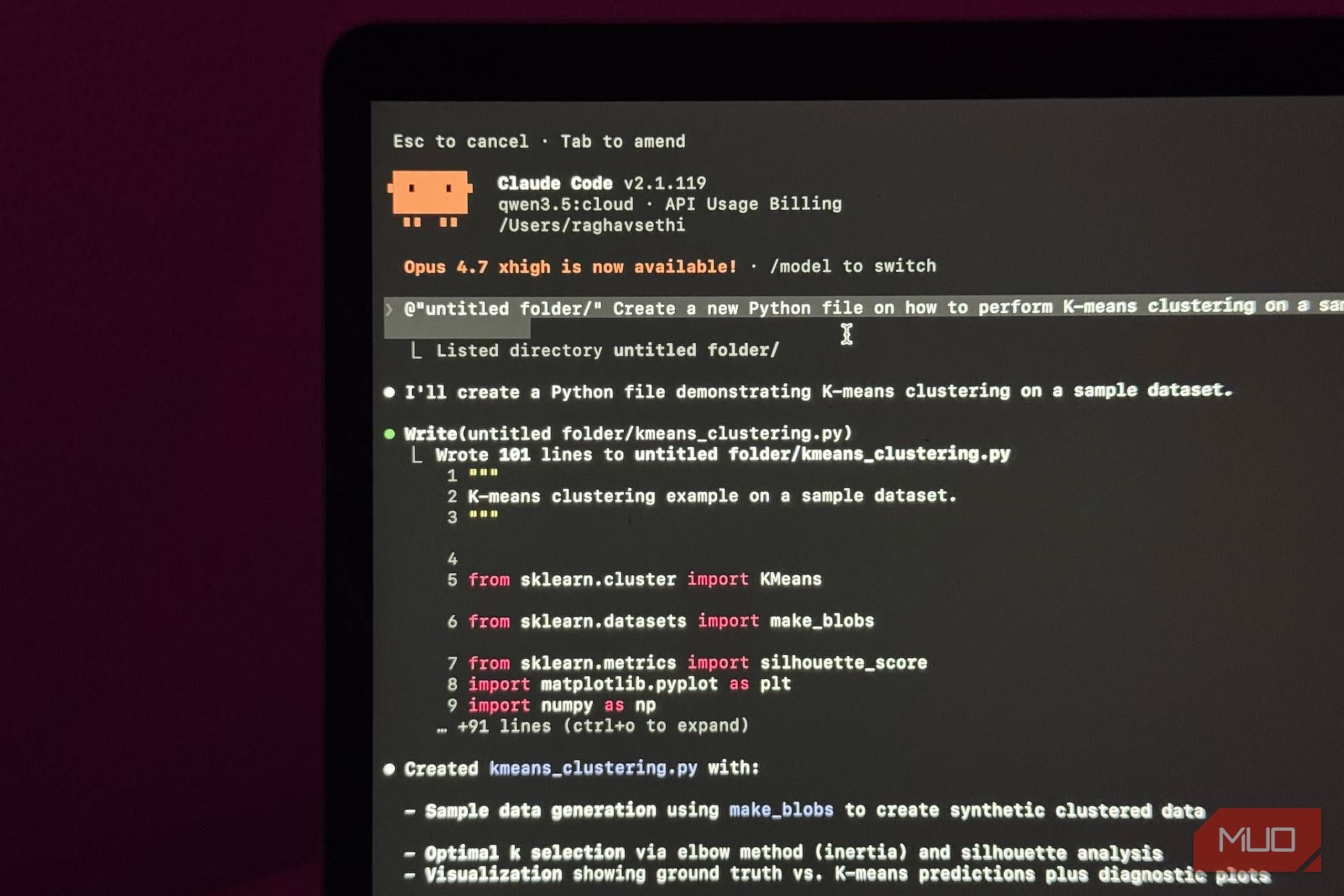

- 접속하기

jimeng.jianying.com(즈몽) 또는 CapCut 앱에서 Seedance 2.0을 사용할 수 있어요. 제3자 서비스인 seedance2.so에서도 무료 체험이 가능해요. - 레퍼런스 준비하기

최대 12개 파일을 넣을 수 있지만, 처음엔 이미지 1~2장 + 텍스트 프롬프트로 시작하세요. "제품 정면 사진 + 카페 배경에서 손에 들고 있는 15초 영상" 같은 식으로요. - 생성 & 확인

1080p 5초 클립 기준 약 90초~3분이 걸려요. 결과를 확인하고, 마음에 안 드는 부분은 텍스트 명령으로 수정할 수 있어요 — 전체 재생성 없이요. - 반복 & 다듬기

1차는 컷 구성만 맞추고, 2차에서 스타일을 다듬는 방식이 효율적이에요. 뮤직 비디오라면 오디오를 먼저 넣고 "비트에 맞춰 2초마다 컷 전환"처럼 간결하게 지시하세요. - 다운로드 & 활용

완성된 영상을 다운로드해서 SNS, 광고, 제품 데모에 활용하세요. 상업용이라면 저작권 확보된 소스만 레퍼런스로 쓰는 것 잊지 마세요.