你有没有问了ChatGPT,"哦原来如此"就过去了?旅行计划、邮件草稿、商业战略,答案流畅地出来,就觉得应该是对的。但如果那个答案是错的呢?Wharton研究者对1300人进行实验,结果发现AI给出错误答案时,80%的人直接接受了。没有验证。

这是什么?

宾夕法尼亚大学Wharton School认知行为科学家Steven D. Shaw和Gideon Nave教授于2026年2月发表的研究。 论文标题很有启示性:Thinking — Fast, Slow, and Artificial: How AI is Reshaping Human Reasoning and the Rise of Cognitive Surrender.

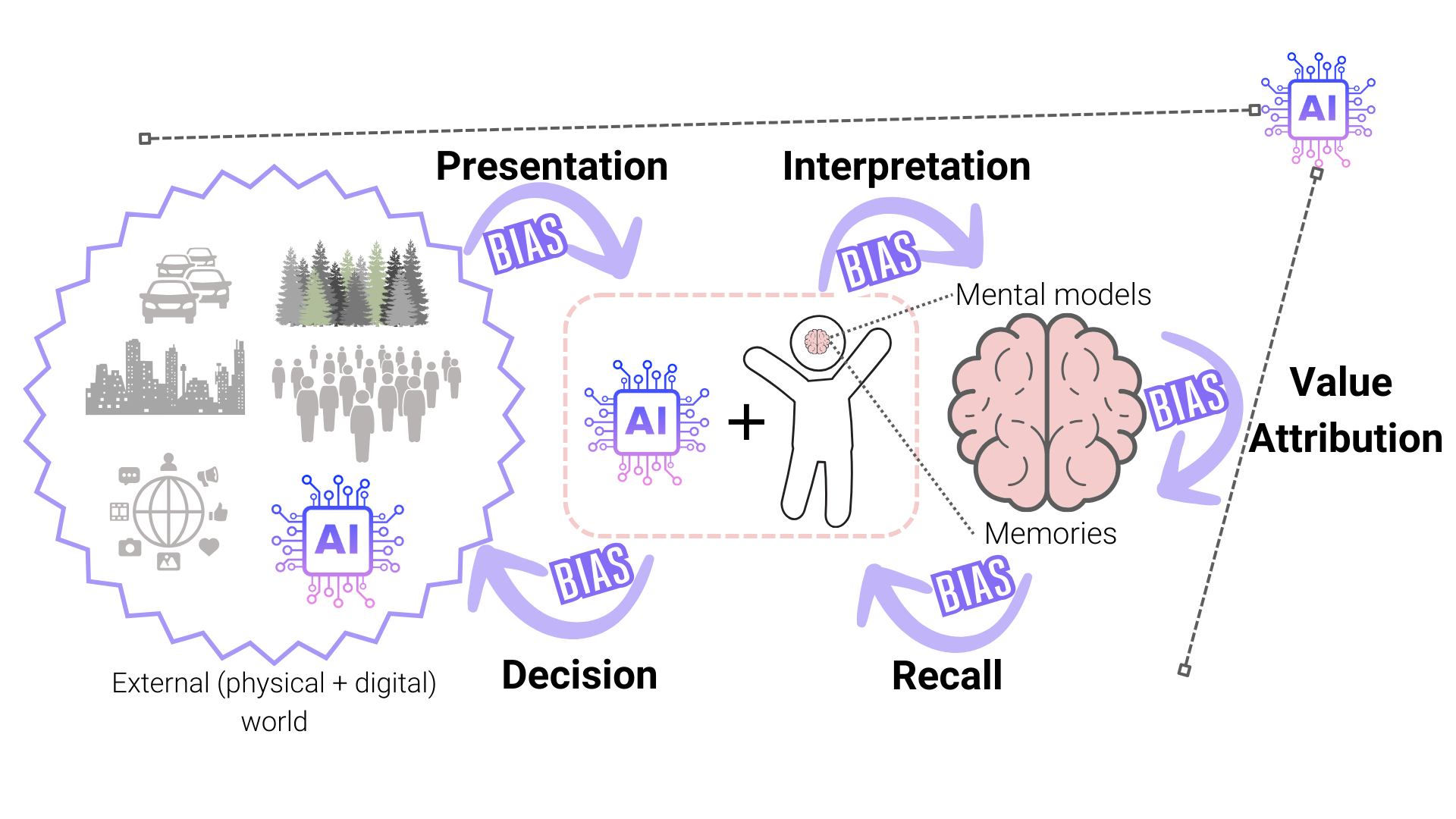

你知道丹尼尔·卡尼曼的《思考,快与慢》(Thinking, Fast and Slow)吗?快速直觉的系统1和缓慢分析的系统2。Shaw和Nave在此基础上提出了加入第三个系统 — AI这个外部认知引擎,即"系统3"的"三重系统理论(Tri-System Theory)"。

核心主张是:人们不是把AI当"工具"用,而是将自己大脑的思考过程本身委托给了AI。研究者将这种现象称为"认知投降(Cognitive Surrender)"。

和以往"AI不信任"研究有什么不同?

之前提到的Quinnipiac调查研究说的是"人们不信任AI(76%不信)"这种态度。这次Wharton研究恰恰相反 — 说的是人们在行为上几乎无条件信任AI。嘴上说"不相信AI",实际上AI给出答案时却不加验证地跟着走。说的和做的是两回事。

数据说明了什么?

来自1372名参与者、9500余次个人实验的数据。

研究者称之为"未经验证的采纳(adoption without verification)"。 参与者向ChatGPT提问,得到答案后直接跳过了验证答案是否正确的过程。

更可怕的是自信心。AI给出错误答案,跟着走的人主观自信心反而上升了。 "AI确认了,我应该是对的"的心理。根本不知道自己错了。

| 适度信任(Calibrated Trust) | 过度信任/认知投降 | |

|---|---|---|

| AI使用方式 | 作为参考资料之一 | 直接采用为最终答案 |

| 验证行为 | 核实来源,交叉验证 | 省略验证(adoption without verification) |

| 遇到错误答案 | 质疑 → 再确认 | 直接接受(80%) |

| 自信心变化 | 随答案质量调整 | 使用AI本身就让自信心上升 |

| 思考过程 | 系统2启动(分析性思考) | 委托给系统3(认知投降) |

| 长期影响 | 判断力维持 | 判断力退化风险 |

Shaw教授的解释一针见血:

"人们把自己的思考交给AI,让AI代替自己思考。完全绕过了内部大脑的思考过程。"

— Steven D. Shaw, Wharton School

为什么会这样?研究者指出"流畅性启发式(fluency heuristic)"是原因。 AI生成的文本语法完美、结构清晰、语气自信。我们的大脑倾向于自动将这种"流畅的信息"解读为"准确的信息"。这就是AI的幻觉感觉比人写的更有说服力的原因。

还有一点 — 分析性思考较少的人和更信任技术的人认知投降程度更深。 这意味着性格特征可能成为AI过信的脆弱点。

核心总结:防范AI过信的5个实战习惯

研究者不是说别用AI。AI答对时正确率能提升25个百分点呢。核心是"用,但不要投降"。

- "真的吗?"3秒规则

收到AI回答后,接受之前先停3秒问自己 — "这真的对吗?"这个小习惯能唤醒系统2。研究中给予绩效激励和实时反馈时认知投降减少,也是同样的道理。 - 要求AI提供来源

在提示词中加上"请注明来源"。AI无法提供来源或给出虚假来源时,就是质疑那个答案本身的信号。搭配Perplexity这类自动标注来源的工具,交叉验证更容易。 - 先思考,再问AI

用"我是这么认为的,有没有遗漏的地方?"的形式提问。先整理自己的想法再让AI审查,系统2已经在运转,盲目接受就会减少。 - 涉及重大决策的信息必须交叉验证

招聘、投资、战略决定等难以逆转的判断,不要只依赖一个AI。向其他AI模型提同样的问题,或寻求人类专家意见。答案不一致时亲自深入研究。 - 在团队中设立"AI红队"角色

会议上有人说"AI是这么说的"时,让一个人固定扮演质疑者的角色。"那个AI的答案是怎么验证的?" — 这一个问题能防止整个组织的认知投降。

为什么"不信任"和"过度信任"能同时存在?

Quinnipiac调查中76%的人说"不信任AI",而Wharton实验中80%的人照单接受了AI的错误答案。看似矛盾,实际上是不同维度的问题。调查问的是"抽象态度(对AI这项技术有多信任)",实验测量的是"具体行为(答案摆在眼前时怎么做)"。人在"原则上"不信任AI,却在方便的答案出现时跳过验证。这才是认知投降真正可怕的地方。