ChatGPTに聞いて「ああそうか」と流したことありますよね?旅行計画、メール草案、事業戦略まで。答えがスムーズに出てくるから合ってるだろうと思います。でもその答えが間違っていたら?Whartonの研究者が1,300人を実験した結果、AIが誤った答えを出したとき80%がそのまま受け入れました。検証なしで。

これは何?

ペンシルバニア大学Wharton Schoolの認知行動科学者Steven D. ShawとGideon Nave教授が2026年2月に発表した研究です。 論文タイトルが示唆的です: Thinking — Fast, Slow, and Artificial: How AI is Reshaping Human Reasoning and the Rise of Cognitive Surrender.

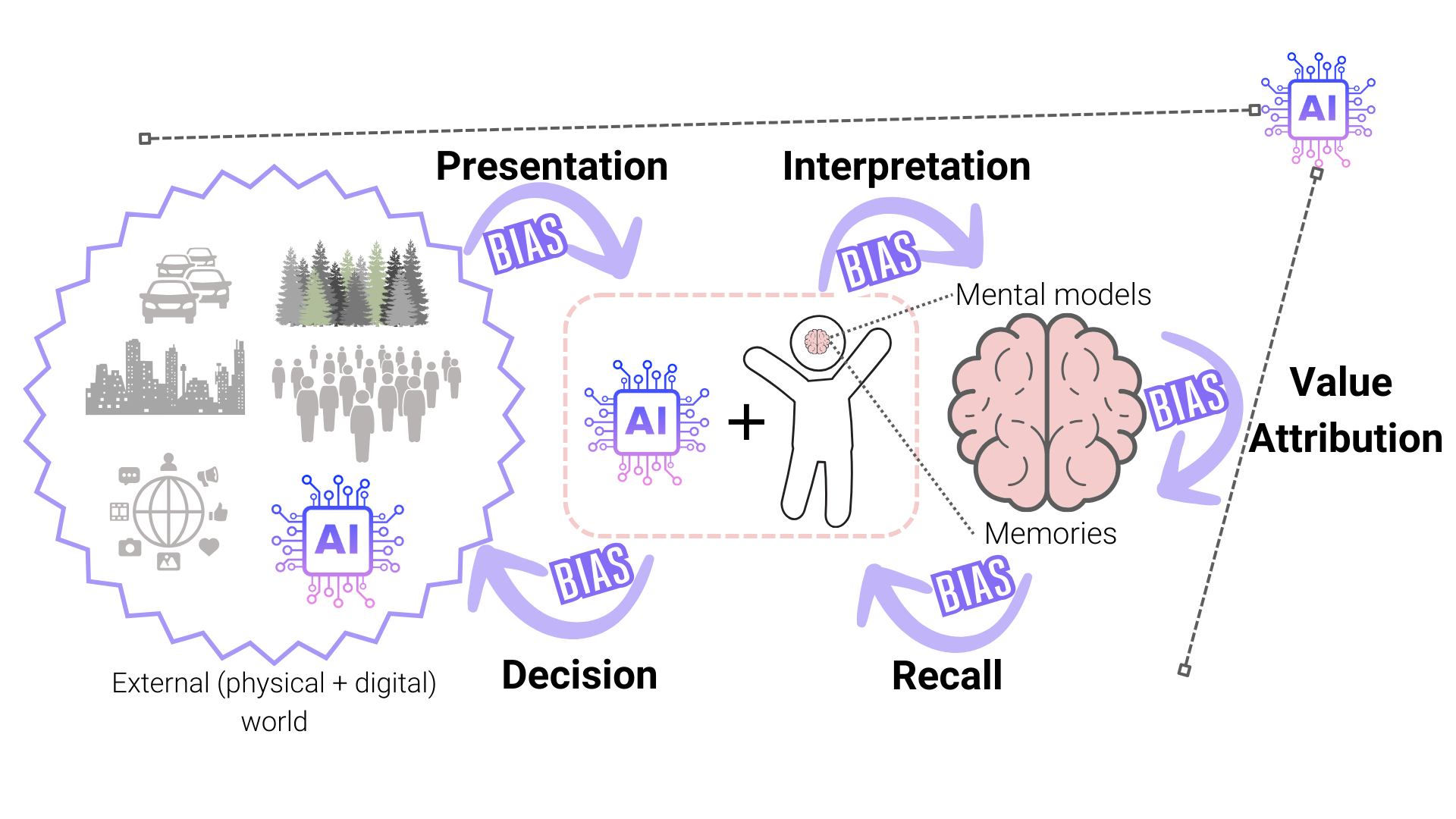

ダニエル・カーネマンのファスト&スロー(Thinking, Fast and Slow)をご存知ですか?速くて直感的なシステム1と、遅くて分析的なシステム2。ShawとNaveはここに第三のシステム — AIという外部認知エンジン、「システム3」を加える「三重システム理論(Tri-System Theory)」を提案します。

核心的な主張はこれです:人々がAIを「道具」として使うのではなく、自分の脳の思考プロセス自体をAIに委ねているということです。研究者はこの現象を「認知的降伏(Cognitive Surrender)」と呼びます。

既存の「AI不信」研究と何が違うの?

以前取り上げたQuinnipiac Poll研究は「人々がAIを不信する(76%が信じない)」という態度の話でした。今回のWharton研究は正反対です — 人々が行動ではAIをほぼ無条件に信頼するということです。「AIを信じられない」と言いながらも、AIが答えを出すと検証なしに従います。言葉と行動が違うのです。

データは何を示しているのか?

1,372人の参加者、9,500件以上の個別実験から出た数字です。

研究者はこれを「検証なしの採択(adoption without verification)」と呼びます。 参加者はChatGPTに質問し、答えが来るとその答えが正しいか確かめるプロセス自体をスキップしました。

さらに怖いのは自信です。AIが誤った答えを出したのに、それに従った人の主観的自信はむしろ上がりました。 「AIが確認してくれたから自分が正しい」という心理。誤りに気づかないのです。

| 適切な信頼(Calibrated Trust) | 過信/認知的降伏 | |

|---|---|---|

| AI活用方法 | 参考資料の一つとして活用 | 最終答えとして採択 |

| 検証行動 | 出典確認、クロス検証 | 検証省略(adoption without verification) |

| 誤答への対応 | 疑問 → 再確認 | そのまま受容(80%) |

| 自信の変化 | 答えに比例して調整 | AI使用自体で自信が上昇 |

| 思考プロセス | システム2作動(分析的思考) | システム3に委任(認知的降伏) |

| 長期的影響 | 判断力維持 | 判断力退化リスク |

Shaw教授の説明は鋭いです:

「人々は自分の考えをAIに渡し、AIに代わりに考えさせます。内部の脳の思考プロセス全体を迂回するのです。」

— Steven D. Shaw, Wharton School

なぜこんなことが起きるのでしょう?研究者は「流暢性ヒューリスティック(fluency heuristic)」を指摘します。 AIが作るテキストは文法的に完璧で、構造がきれいで、自信ある口調で書かれています。私たちの脳はこういう「滑らかな情報」を自動的に「正確な情報」と解釈する傾向があります。AIのハルシネーションが人間が書いたものより説得力があると感じる理由です。

もう一つ — 分析的思考をあまりしない人と技術をより信頼する人ほど認知的降伏が激しかったです。 これは性格特性がAI過信の脆弱点になり得るということです。

核心まとめ:AI過信を防ぐ5つの実践ルーティン

研究者はAIを使うなということではありません。AIが正解したとき正答率が25ポイントも上がりますから。核心は「使うが、降伏するな」です。

- 「本当に?」3秒ルール

AI回答を受け取ったら、受け入れる前に3秒だけ止まって問いかけてください — 「これって本当に合ってる?」このちょっとした習慣がシステム2を呼び覚まします。研究でパフォーマンスインセンティブとリアルタイムフィードバックを与えたとき認知的降伏が減ったのも同じ原理です。 - AI回答に出典を要求してください

「出典を付けて」とプロンプトに追加してください。AIが出典を出せなかったり偽の出典を示したら、その答え自体を疑うシグナルです。Perplexityのように出典を自動で付けるツールを併用すると交差検証が楽になります。 - 先に考えて、後でAIに聞いてください

「私はこう思うんだけど、抜けてることある?」という形で聞いてください。自分の考えを先にまとめてからAIに検討させると、システム2がすでに作動している状態なので盲目的な受容が減ります。 - 意思決定級の情報は必ず交差検証

採用、投資、戦略決定のように取り消しにくい判断にはAI一つに依存しないでください。別のAIモデルに同じ質問を投げかけるか、人の専門意見を求めてください。答えが分かれたら自分で深く掘り下げてください。 - チームに「AIレッドチーム」の役割を作ってください

会議で誰かが「AIがこう言った」と言うとき、一人が必ず反問する役割を担ってください。「そのAIの答えをどう検証したの?」— この質問一つが組織全体の認知的降伏を防ぎます。

なぜ「不信」と「過信」が同時に存在するの?

Quinnipiac調査で76%が「AIを信じない」と答えたのに、Wharton実験で80%がAIの誤った答えをそのまま従いました。矛盾しているようですが、実は異なる次元です。調査は「抽象的態度(AIという技術をどれだけ信頼するか)」を問い、実験は「具体的行動(答えが目の前にあるときどうするか)」を測定します。人はAIを「原則的に」信じないと言いながら、便利な答えが出ると検証をスキップします。これが認知的降伏の本当に怖いところです。