다들 "어느 AI 이미지 모델이 제일 좋아?"부터 묻잖아요. 근데 광고·이커머스 현장에서 진짜 일어나는 일은 다르더라고요. 한 장의 결과물을 만드는 데 모델이 한 개가 아니라 5개씩 줄줄이 붙어 있어요. a16z의 2026 제너레이티브 미디어 리포트가 짚어낸 건 결국 이거예요.

왜 모델이 5개씩 붙는 건데?

a16z 파트너 Jennifer Li와 Justine Moore가 2월에 낸 The State of Generative Media 2026 리포트는 fal.ai의 생산 데이터(600+ 모델, 수억 명 사용자)를 기반으로 작성됐어요. 가장 자주 인용되는 수치는 "엔터프라이즈 배포가 평균 14개 모델을 동시에 쓴다"는 부분인데요, 진짜 의미는 그 14개가 어떻게 엮이느냐에 있어요.

리포트는 "포토리얼 이미지에 강한 모델"이 "배경 제거나 사운드 생성"까지 잘하는 건 아니라고 못박아요. 그래서 일을 잘하는 팀은 한 모델에 다 시키지 않고, 단계별로 다른 모델을 박아넣어요. 광고 한 컷의 실제 파이프라인은 이런 식이에요.

- 이미지 생성

Flux 같은 빠른 모델로 1차 컴포지션을 뽑아요. 후보 수십 장을 빠르게 돌리는 단계. - 배경 제거(누끼)

전용 segmentation 모델로 깨끗한 알파 채널 추출. 이건 이미지 생성 모델이 잘 못 해요. - 업스케일

4K/8K로 끌어올리는 별도 모델. 인쇄·OOH용은 여기서 품질이 갈려요. - 리컬러 + 보정

브랜드 컬러에 맞게 톤 조정. inpainting/edit 전용 모델로. - 스타일 LoRA 적용

자사 LoRA를 입혀 브랜드 일관성 확보. 캠페인 수백 컷에 같은 룩을 유지하는 핵심.

리포트는 이걸 단순 워크플로우가 아니라 "inference에서 orchestration으로의 이동"이라고 표현해요. fal.ai도 이 흐름을 읽고 "단순 모델 서빙"에서 "워크플로우 오케스트레이션 + 파인튜닝 서비스"로 제품 라인을 확장했어요.

뭐가 달라지는 건데?

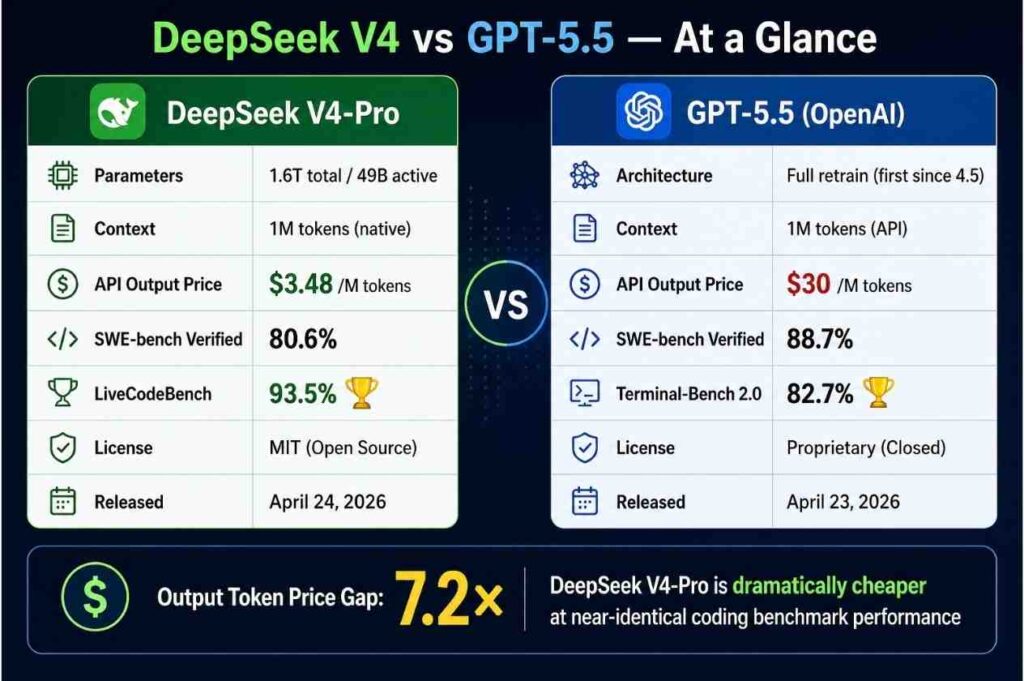

LLM 시장하고 정반대로 가고 있어요. ChatGPT·Gemini·Claude 3개가 LLM 엔터프라이즈 지갑의 89%를 먹고 있는데, 제너레이티브 미디어 쪽은 의도적으로 파편화되는 중이에요.

| LLM 시장 (집중) | 제너레이티브 미디어 (분산) | |

|---|---|---|

| 지갑 점유 | 3개 모델이 89% | 상위 모델도 단일 점유 불가 |

| 배포 패턴 | 한 모델 깊게 | 평균 14개 동시 사용 |

| 경쟁 축 | 모델 성능 | 체이닝/오케스트레이션 |

| 릴리스 주기 | 분기/연 단위 | 4~6주마다 신규 모델 |

여기서 두 번째 포인트가 결정적이에요. 같은 픽셀이라도 가치가 다르다는 거죠. a16z·Artificial Analysis 조인트 설문에서 58%의 조직이 모델 인프라 선정 기준으로 "비용 최적화"를 1순위로 꼽았어요. 모델 가용성이나 속도보다 비용이 먼저였다는 거예요.

이걸 현장 패턴으로 풀면 이렇게 돼요. 썸네일·피드 이미지처럼 대량으로 찍어내는 자산은 Flux 같은 빠른 모델, 캠페인 히어로컷이나 로고는 Nano Banana Pro 같은 프리미엄 모델. 한 회사 안에서 자산별로 모델을 라우팅하는 게 표준이 됐어요.

광고 현장은 이미 이 흐름을 타고 있어요. Silverside AI가 ComfyUI 파이프라인으로 만든 SVEDKA 2026 슈퍼볼 광고가 사실상 첫 "주로 AI 생성"인 슈퍼볼 광고로 기록됐고, Black Math 같은 스튜디오들도 모션·텍스처·생성 도구를 노드 기반으로 체이닝해서 일회성 결과물이 아니라 클라이언트가 빌드업할 수 있는 디자인 시스템을 만들고 있어요. 국내에서도 LG유플러스가 자체 AI '익시(ixi)'와 외부 모델 8,300여 개 소스·20만 프레임을 체이닝해 100% AI TV광고를 송출한 게 같은 결의 신호예요(기존 3D 광고 대비 비용 40%·기간 70% 절감).

이커머스 쪽은 더 직접적이에요. 리포트는 "사진작가 팀 + 몇 주의 촬영 + 긴 편집"이 "프롬프트 몇 개 + 프로덕션-레디 에셋 라이브러리"로 바뀌고 있다고 정리해요. 수천 개 SKU의 시즌·라이프스타일 컷을 만들 때 단일 모델이 아니라 체인이 돌아간다는 게 핵심이에요.

오픈소스는 왜 다시 떠오르는 건데?

예전엔 "오픈소스 = 싸다"였잖아요. 근데 리포트는 이걸 뒤집어요. 오픈소스가 떠오르는 이유는 가격이 아니라 파인튜닝 가능성이라는 거예요.

핵심 인용 — a16z 리포트

"브랜드 일관성, 캐릭터 지속성, 또는 수백만 개 자산에 걸친 제품 충실도가 필요할 때, 자기 데이터로 파인튜닝하는 건 옵션이 아니라 게임 그 자체다."

대부분의 상용 API는 파인튜닝을 막거나 매우 제한적으로만 열어요. 그래서 캐릭터·제품 충실도가 핵심인 워크로드는 Flux나 Qwen Image Edit 같은 오픈 모델로 옮겨가는 중이에요. 2025년 한 해 동안 오픈 모델이 품질 격차를 "예상보다 빠르게 좁혔다"는 게 리포트의 결론이고요. ComfyUI가 4월에 5,000억 원 밸류에이션으로 $30M을 조달한 것도 이 흐름의 부산물이에요. 노드 기반 오픈소스 워크플로우 엔진이 엔터프라이즈 크리에이티브의 표준 도구가 되고 있다는 신호.

그래서 뭘 어떻게 해야 하는 건데?

- "한 모델 선정"부터 버리기

"어떤 모델이 최고냐"는 질문은 2025년 질문이에요. "어떤 단계에 어떤 모델을 박을까"로 바꾸세요. 단계별 최적 모델이 다르다는 전제부터 출발. - 현재 워크플로우를 5단계로 분해

지금 만드는 자산 1개를 잡고 생성→가공→편집→일관성→최종 출력 5단계로 그려보세요. 각 단계에 지금 어떤 도구가 있고, 어디가 병목인지 보여요. - 비용 라우팅 규칙 정하기

썸네일/피드 자산은 빠른 모델, 히어로컷은 프리미엄. "히어로컷만 비싼 모델 쓴다"는 규칙 하나만 박아도 비용이 절반 가까이 떨어져요. - 오케스트레이션 레이어 선택

API 통합형으로 갈지(fal.ai, Wireflow), 노드 기반 자체 호스팅으로 갈지(ComfyUI) 결정. 브랜드 자산이 민감하면 후자가 유리해요. - 파인튜닝 자산부터 만들기

브랜드 LoRA 한 개만 학습시켜도 캠페인 일관성이 확 올라가요. 이게 오픈소스로 가는 가장 빠른 진입점이에요.

흔한 함정

"모델 하나를 정해서 거기에 다 시킨다"는 접근은 2026년 환경에선 비효율이에요. 단일 모델로는 배경 제거·업스케일·LoRA 같은 작업이 어색하게 나와요. 단계별 분리가 결과물 품질의 출발점입니다.